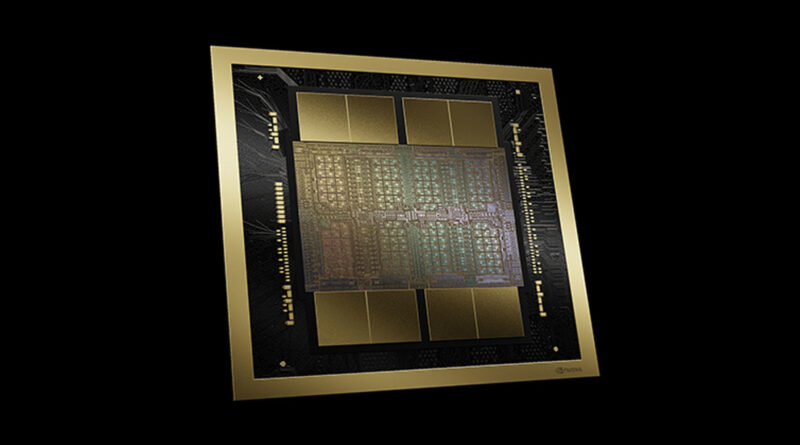

La multinacional Nvidia da a conocer el “chip más potente del mundo” que mejorará la IA generativa

NVIDIA

- Su nueva familia de superchips Blackwell llevará la creación y ejecución de IA generativa a otro nivel, ya que son hasta 30 veces más rápidos y consumen 25 veces menos energía.

12HORAS / CALIFORNIA, EU.-Nvidia presentó este lunes una nueva generación de chips y unidades de procesamiento gráfico (GPU) bajo el nombre de Blackwell, encaminada a impulsar y mejorar, entre otros, la industria de la inteligencia artificial (IA) generativa.

El fabricante de semiconductores más importante de EU asegura que sus GPU Blackwell B200 ofrecen una significativa mejora de rendimiento, con velocidades de 20 petaflops gracias a los 208.000 millones de transistores. «Son el motor que impulsará esta nueva revolución industrial», aseguró su director ejecutivo, Jensen Huang, en un evento anual de la compañía en San José (California, EU.).

Nvidia también presentó su Blackwell GB200, «el chip más potente del mundo», que combina dos GPU B200 y una CPU Grace que pueden comunicarse entre sí a velocidades de hasta 10 terabytes por segundo.

De este modo, puede ofrecer «hasta 30 veces» más rendimiento para cargas de trabajo de modelos grandes de lenguaje (LLM, por sus siglas en inglés) y, al mismo tiempo, ser sustancialmente más eficiente. «Reduce el costo y el consumo de energía hasta 25 veces», subraya la empresa.

Crean en China un chip fotoelectrónico 3.000 veces más rápido que sus rivales de EU

La familia de superchips Blackwell, bautizada así en honor al matemático especializado en teoría de juegos y estadística, David Harold Blackwell —el primer académico negro incluido en la Academia Nacional de Ciencias—, llegará a finales de este año en reemplazo de su popular serie de superchips Hopper H100, que convirtió a Nvidia en una de las empresas más valiosas del mundo.

Actualmente, casi todas las compañías de IA los utilizan para entrenar grandes modelos de lenguaje que impulsan servicios como ChatGPT.

Sin embargo, los Blackwell prometen llevar esta práctica a otro nivel. De acuerdo con el portal The Verge, si hasta ahora para entrenar un modelo de 1,8 billones de parámetros se necesitaban 8.000 GPU Hopper y 15 megavatios de potencia. Hoy, 2.000 GPU Blackwell pueden hacerlo consumiendo nada más cuatro megavatios.

Blackwell es varias veces más rápido en el manejo de los modelos que sustentan la IA y, por tanto, será la base de trabajo de muchas de las grandes empresas líderes, como Amazon Web Services, Dell Technologies, Google, Meta, Microsoft, OpenAI, Oracle, Tesla y xAI. «Trabajando con las empresas más dinámicas del mundo, haremos realidad la promesa de la IA para todas las industrias», señala al respecto Huang.

Se presume que esta tecnología no solo beneficiará a los principales líderes en IA, sino que también permitirá avances en el «procesamiento de datos, la simulación de ingeniería, la automatización del diseño electrónico, el diseño de fármacos asistido por computadora y la computación cuántica», afirma la multinacional.

RT

Compartir: